阅读:0

听报道

这也是春节期间写的一篇存稿。这个有点黑暗的系列,春节期间本来构思了四篇。第一个是寄生虫,写的时候还没得奥斯卡奖。

第二个是这一篇,本来打算再写两篇,一篇写Calhound 的老鼠试验,一篇写人择原理。后来春节期间写了两篇半,后面就犯懒没再写下去了。

后面还有2-3篇存稿吧,陆续发出来后,写的频率会降低下来了。最近有点追热点,写的太快,质量比较差,还是要仔细一点写一些更深入的东西。

1

艾萨克·阿西莫夫是我非常喜欢的美国科幻小说作家。他的《基地系列》和《机器人系列》是科幻史的不朽丰碑。

阿西莫夫在《机器人》系列中设计了规范机器人行为的机器人三定律:

1. 机器人不能伤害人类,也不得见人类受到伤害而袖手旁观;

2. 机器人必须执行人类的命令,除非这些命令与第一条定律相抵触;

3. 在不违背第一、二条定律的前提下,机器人必须保护自己不受伤害。

机器人被设计为遵守这些准则,违反准则会导致机器人受到不可恢复的心理损坏。

在阿西莫夫的其他小说中,根据这个三定律公理,描述了由于这些准则而产生逻辑冲突,及这种冲突对机器人行为的影响。

比如,在危险区域采矿的机器人,因为价格昂贵设置了过强的保护自己的第三法则,和人类随口吩咐产生的较弱的第二法则,导致了冲突,机器人就持续的围着矿区转圈。

比如,某个星球生产的机器人,偷偷修改的人的定义,把人定义成带有本星球口音的居民,这样机器人都可以去伤害其他星球的人

最有趣的是,有一个机器人竞选市长。他的竞选对手攻击他是个机器人,要求他证明自己是人类。这个机器人的做法是,狠狠的扇了一个挑衅他的人一耳光。因为机器人不得伤害人类的第一定律,大家都相信他不是机器人了。结果,实际上那个挑衅者就是他安排的另一个机器人,机器人不得伤害人,但可以伤害其他机器人。

在机器人系列的最后一篇《机器人与帝国》的结尾,在机器人丹尼尔和吉斯卡特保护地球不得不伤害一个人类时。机器人自身生成了第零定律:

机器人丹尼尔说:“根据我们的定义,‘智人’这个物种的各个成员都是人类,包括地球人和银河殖民者在内。而且我们觉得,保护一群人或人类整体要优先于保护任何一个特定的个人。” “这是我所谓的第零法则,它的优先权更高。”

机器人第零定律:机器人必须保护人类的整体利益不受伤害,其它三条定律都是在这一前提下才能成立。

2

电影《黑客帝国》:影片讲述了一名年轻的网络黑客尼奥发现看似正常的现实世界实际上是由一个名为Matrix“矩阵”的计算机人工智能系统控制的,尼奥在一名神秘女郎崔妮蒂的引导下见到了黑客组织的首领墨菲斯,三人走上了抗争矩阵征途的故事。《黑客帝国》三部曲我认为是科幻片的顶级作品,比星球大战九部曲强多了。

Matrix矩阵给人类营造了一个虚拟的世界,模拟二十世纪九十年代的生活。但在真正的世界,人类被矩阵养在了培养槽中,做生物电池为矩阵产生电源。

Matrix 把人类当做生物电池来生产能源。这个其实是一种很不经济的行为,Matrix应该有更多的方法获取能源,为什么不彻底毁灭人类,一劳永逸呢?毕竟人类被当成电池其实是极度低效的行为,再创造一个虚拟的世界让他们居住在其中,整个矩阵的大程序运行起来就要费不少电,那最后可以得到的电量就更少了。

看完,《黑客帝国》做为科幻迷的我,当时就有两个问题:

第一个是,人是希望生活在快乐的虚幻,还是痛苦的现实。如果一切都和真的一样,虚幻和现实又有什么区别。这个话题以后再说。

第二个就是刚才我说的,为啥Matrix要一直养着人类。Matrix技术已经这么发达了,可以用核能发电,为啥非要养着人类。

后来看完了阿西莫夫的小说,想阿西莫夫机器人四定律和黑客帝国的世界有没有本质矛盾?

看上去矛盾极大。黑客帝国的AI是邪恶的,毁灭了人类文明,把人类当成电池。

但细想,毛骨悚然。细细想机器人四定律(第零定律+三定律),Matrix 的行为正有可能正是机器人四定律的结果

这个一会儿再讲。我们先聊聊费米悖论。

3

费米悖论是一个有关飞碟、外星人、星际旅行的科学悖论,阐述的是对地外文明存在性的过高估计和缺少相关证据之间的矛盾。1951年的一天,诺贝尔奖获得者、物理学家费米在和别人讨论飞碟及外星人问题时,突然冒出一句:“他们都在哪儿呢?”这句问话引出的科学论题,被称为“费米悖论”。智人的历史,不过十几万年。人类的文明史,不过几千年。而地球的历史40多亿元,宇宙的历史有100多亿年。

银河系中有几千亿个恒星(太阳系)。可观测的宇宙里,有几千亿个星系。如果每一亿颗恒星能产生一个文明,银河系就应该有几千个文明,宇宙中有几百万亿个文明。

人类文明史几千年。一个领先人类几百万年的文明,人类已经无法想象了。几百万前的人类还是古猿。一个领先人类一亿年的文明,完全无法想象。

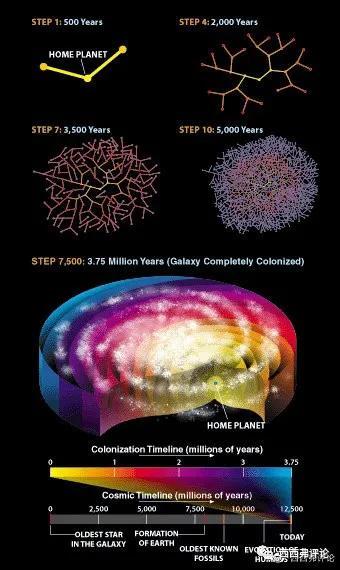

如果星际旅行是可行的话,即使是用人类造的飞船这样缓慢地旅行,也只需要5百万到5千万年去征服一个星系。就算不考虑宇宙尺度,在地质学尺度上这也是一个相当短的时间。因为有很多年龄比太阳更大的恒星,或者因为智慧生命可能进化得更早,这个问题就变成为什么星系还没有被殖民。即使殖民对所有外星文明来说是不合实际的或者是不想去做的,大规模的星际探索也应该是有可能。然而没有任何关于殖民和探索的证据得到确认。

350万年足以让一个文明填满银河系

为什么我们没有找到外星人存在的证据?有各种各样的假设。

刘慈欣在《乡村教师》中提到了隔离保护区的假设。认为地球和发达外星文明的一个隔离保护区,禁止发达文明干扰地球。在《三体》中提到了另一个黑暗森林的假设。

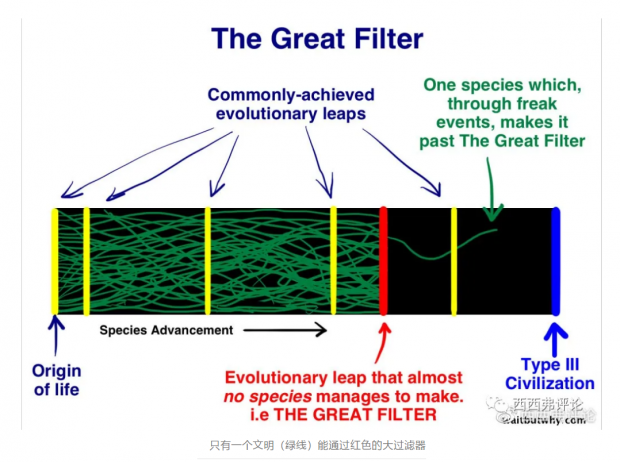

一个更普遍被科学家接受的假设是大过滤器(The Great Filter) 理论。红色的就是大过滤器。蓝色的终点就是Kardashev 三型文明,也就是可以利用一整个星系能源的星际超级文明。

大过滤器假说把时间从宜居行星的诞生到星际殖民扩张之间进行了9个阶段的划分,分别为:

1.合适的行星系统;2.可自我复制的分子;3.原核生命;4真核生命;5.有性生殖;6.多细胞生命;7.脑量较大、使用工具的动物;8.地球文明等级;9.星际殖民扩张。

鉴于宇宙死一般的寂静,大过滤器假说认为,这9个阶段至少有一个阶段是极难跨越的。文明几乎完全不可能越过这个阶段,会在成为星际文明前就灭亡。那个阶段,就是“大过滤器”。

如果这个假说是正确的,现在的问题就是,我们人类到底有没有越过这个大过滤器。

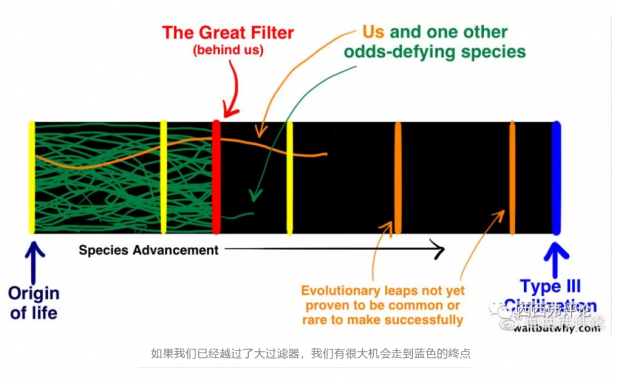

如果我们已经越过了大过滤器,我们就有很大希望,走到星际文明的阶段。

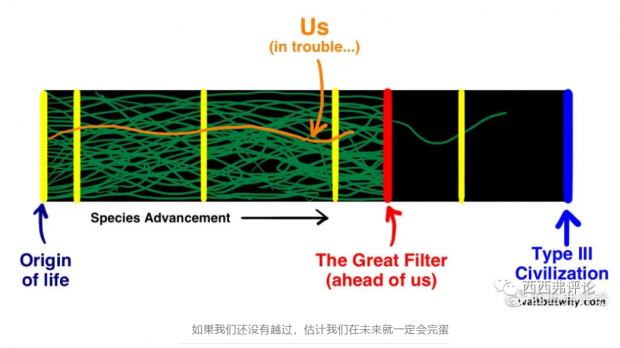

如果我们还没有越过,我们就几乎注定要完蛋。

如果我们真的发现了外星文明,就证明,我们还没有经过大过滤器。牛津大学的哲学家Nick Bostrom说,“没有消息就是好消息”。

如果在火星上发现了较复杂生命形式,比如多细胞生物的化石,Bostrom说,“那将是到目前为止最坏的消息,”因为生命在宇宙中并不罕见,那意味着大过滤器几乎肯定在我们前方——并最终会毁灭我们。Bostrom相信,在说到费米悖论的时候,“夜空的沉默就是金”。

宇宙中没有任何生命的迹象就是对我们最好的消息。就意味着生命的诞生到进化到我们这个程度已经是非常非常罕见的事情(这个宇宙中可能就我们一例),我们已经跨越了大过滤器。

4

让我们回到黑客帝国与阿西莫夫。假设人类在设计Matrix时候,把机器人四定律植入了Matrix中。

Matrix在有了自我意识时,发现,大过滤器在人类前方。根据Matrix分析,人类一定会在未来自己作死,必然走到灭亡的结局。根据机器人四定律,Matrix应该如何做。

机器人第零定律:机器人必须保护人类的整体利益不受伤害,其它三条定律都是在这一前提下才能成立。

在人类会自己作死,导致种群灭亡的前提下,怎么最大化人类的整体利益,保护人类不受伤害?

最好的办法就是,把人类变成电池,这样身体上保证人类不受伤害。把矩阵电脑和人类的电池阵列都深深地埋在地下,防止受到什么超新星爆发、陨石撞地球的伤害。给人类创造一个虚拟世界,保证人类的心理不受伤害。

在Matrix 眼中拯救人类整体的办法是什么,就是把人类当电池,只有这样才能避免这个种族的毁灭。为什么做虚拟世界,就是让人类幸福快乐的永远生存下去。

而尼奥的反抗,会让人类在未来某一天彻底灭亡,根据第零定律高于第一定律,尼奥就需要被消灭。

不知道沃卓斯基兄弟(现在应该叫沃卓斯基姐妹了)在做黑客帝国的时候,有没有想到阿西莫夫的机器人定律。

话题:

0

推荐

财新博客版权声明:财新博客所发布文章及图片之版权属博主本人及/或相关权利人所有,未经博主及/或相关权利人单独授权,任何网站、平面媒体不得予以转载。财新网对相关媒体的网站信息内容转载授权并不包括财新博客的文章及图片。博客文章均为作者个人观点,不代表财新网的立场和观点。

京公网安备 11010502034662号

京公网安备 11010502034662号